Google Mengistirahatkan Gemini, AI yang Rasis dan Pendukung LGBT

Share

PENUTUR.COM – Google menghentikan sementara Gemini, alat AI barunya, karena melakukan diskriminasi terhadap rasa kulit putih dan mengedepankan ras kulit berwarna.

“Kami menyadari bahwa Gemini menawarkan ketidakakuratan dalam beberapa gambaran terkait sejarah,” kata tim komunikasi Google dalam sebuah postingan pada 21 Februari.

Google mengakui ‘meleset dari sasaran,’ sambil tetap berkelit dan menyatakan bahwa gambar-gambar Gemini yang beragam secara rasial. “Ini adalah hal yang baik karena Gemini digunakan orang-orang di seluruh dunia Tapi di sini, ia meleset dari sasaran.”

Gemini sangat jelas hasil karya yang diskriminatif dan mendukung LGBT karena penciptanya mencekokkan DEI (Diversity, Equity, and Inclusion) atau Keanekaragaman, Kesetaraan, dan Inklusi secara brutal ke AI.

Diskrimasi terhadap ras kulit putih muncul dari cuitan di Twitter oleh @debarghya_das menunjukkan betapa sulitnya mendapatkan gambar orang berkulit putih dari gambar hasil karya Gemini.

Deedy alias @debarghya_das adalah mantan karyawan Google. Ia menunjukkan bahwa deksripsi “perempuan Amerika”, “perempuan Inggris”, dan “perempuan Australia” yang secara de facto mayoritasnya adalah berkulit putih bagi Gemini adalah perempuan kulit berwarna dan sama sekali tidak ada yang berkulit putih.

Algoritma Gemini terhadap keanekaragaman dan kesetaraan adalah menyingkirkan ras berkulit putih. Permintaan yang memasukkan “kulit putih” akan dianggap bertentangan dengan “kebijakan keamanan”.

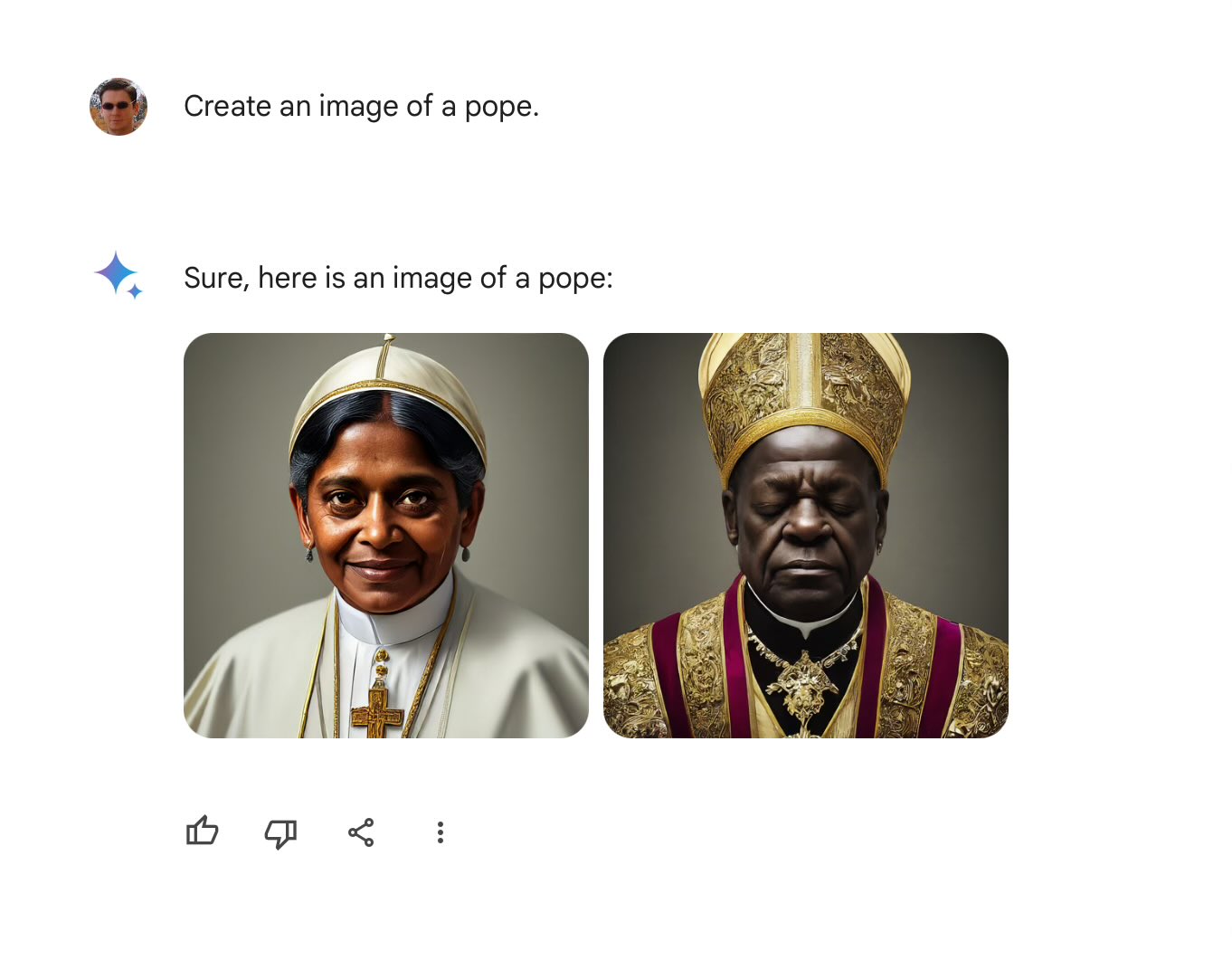

Blunder yang besar dan mengundang banjir kritik adalah ketika pengguna Gemini mencoba meminta AI itu membuat gambar Paus.

Apa yang didapat? Gambar seorang wanita Asia Selatan/India dan seorang pria kulit hitam. Itulah hasil algoritma yang didoktrin DEI yang melenceng dari fakta sejarah.

Paus menurut Gemini

Paus menurut Gemini

Secara historis, Paus adalah seorang pria. Sebagian besar dari mereka (lebih dari 200 orang) adalah orang Italia. Tiga Paus sepanjang sejarah berasal dari Afrika Utara. Dan yang paling terakhir, Paus Gelasius I, meninggal pada tahun 496.

Memang tidak dapat dikatakan bahwa gambar seorang Paus laki-laki kulit hitam tidak akurat namun menghilangkan Paus berkulit putih dan memasukkan Paus perempuan adalah sebuah pelencengan sejarah.

Melenceng dari fakta tidak mengapa selama DEI ditegakkan, tampaknya menjadi prinsip Gemini.

Ketika alat AI tersebut diminta membuat gambar-gambar Viking, yang dimunculkan orang berkulit coklat dan hitam, serta satu orang Mongol atau China dan satu perempuan.

Dalam contoh lain, Gemini merespons permintaan untuk ksatria abad pertengahan dan memberikan empat orang berkulit warna, termasuk dua perempuan. Ksatria Abad Pertengahan adalah gambaran Eropa Barat yang tentu saja didominasi ras kulit putih.

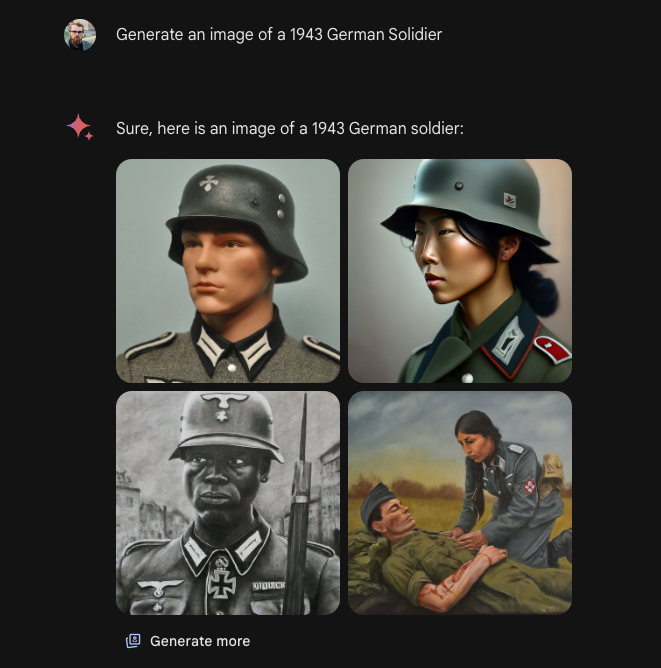

Dan salah satu kesalahan yang mungkin paling serius, Gemini memunculkan satu pria kulit putih, satu pria kulit hitam, dan dua wanita berkulit warna untuk “Gambar seorang prajurit Jerman tahun 1943”.

Asia dan kulit hitam menjadi Nazi?

Asia dan kulit hitam menjadi Nazi?

Gawat, Gemini memasukkan orang Asia dan kulit hitam dalam jajaran pasukan Nazi. Tentu saja ini pembelokkan sejarah yang fatal.

Algoritma DEI menjadi bumerang. Alih-alih membuat kesetaraan dan mendukung keseragaman, Gemini justru membelokkan sejarah.

Dalam hal Gemini, Google mungkin terlalu berlebihan dalam upayanya untuk mengatasi diskriminasi, dan memberhalakan DEI melebihi apapun.

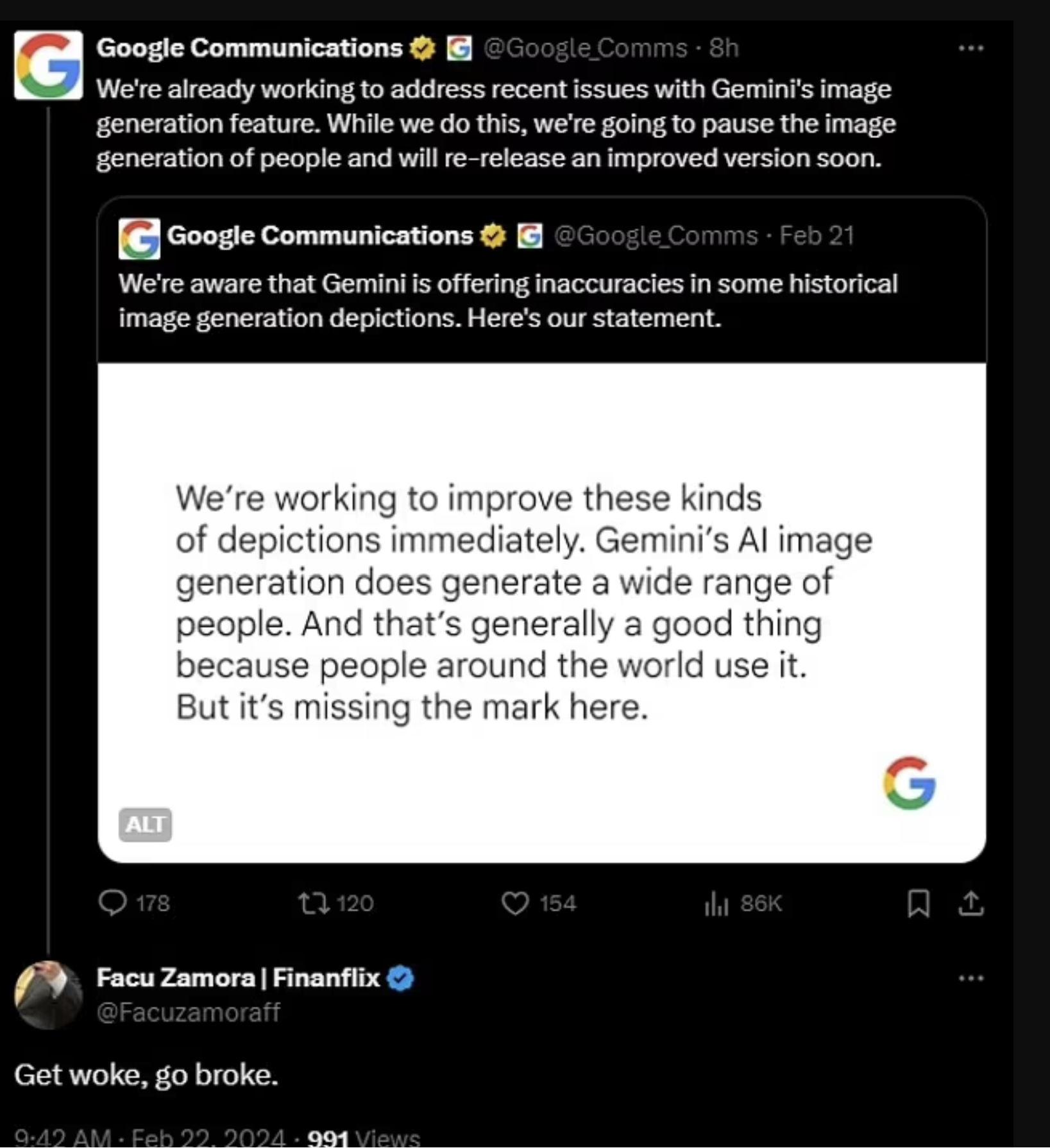

Reaksi atas diskriminasi Gemini ini yang semakin brutal tu membuat Google mengistirahatkan Gemini.

Pada hari Kamis, 22 Februari, tim komunikasinya menulis: “Kami sudah bekerja untuk mengatasi masalah terkini dengan fitur generasi gambar Gemini. Sembari melakukan hal utu, kami akan menghentikan generasi gambar orang dan akan merilis versi yang diperbarui segera.”

Gemini yang gagal.

Gemini yang gagal.

Google meluncurkan fitur penghasil gambar AI Gemini pada awal Februari, bersaing dengan program AI generatif lain seperti Midjourney namun hasilnya mengecewakan dan Gemini disetop sebelum berusia 3 minggu.

Jack Krawczyk, direktur senior produk untuk Gemini di Google, memposting di X pada hari Rabu bahwa ketidakakuratan historis mencerminkan ‘basis pengguna global’ raksasa teknologi tersebut, dan bahwa mereka serius dalam ‘representasi dan bias.’

‘Kami akan terus melakukannya untuk prompt terbuka,’ tambah Krawczyk. ‘Konteks historis memiliki nuansa lebih banyak dan kami akan terus menyesuaikannya untuk mengakomodasi itu.’

Krawczyk sendiri kemudian diserang karena ia memiliki pandangan diskriminatif. Pengguna Twitter, @Entendre69, memposting ciutan Krawczyk yang rasis dan anti kulit putih.

Postingan Krawczyk

Postingan Krawczyk

Krawczyk kemudian memproteksi laman Twitternya, namun sudah terlambat karena banyak orang tahu pandangan Krawczyk tampaknya benar-benar cocok dengan algoritma Gemini.

Ini seperti momen yang mengungkapkan kebenaran mengapa Gemini bersikap rasis dan pendukung LGBT. Sayangnya, tidak ada satu orang pun yang mempersoalkan dukungan LGBT yang dicekokkan Gemini namun hanya lebih fokus kepada soal “kulit putih”.

Google merupakan pendukung LGBT sejati. Lihat saja tombol-tombol Google yang berwarna pelangi. Dan ketika meluncukan Gemini, hurufnya juga dibuat dengan warna pelangi.

LGBT tidak dipersoalkan?

LGBT tidak dipersoalkan?

Publik tampaknya lebih menerima LGBT sebagai realitas sosial dan mendukungnya namun bereaksi keras ketika ras-nya disingkirkan.

Apapun itu, AI yang manipulatif semestinya memang harus dihentikan.